Table of Contents

- 🔍 DeepSeek-R1 décrypté : Comment ça marche ?

- 📊 Performances – Un modèle qui rivalise avec les humains (et les géants de l'IA)

- 💡 Pourquoi DeepSeek R1 change la donne ?

- 🔮 L’Avenir de l’IA Open Source

- 🚨 Les limites de DeepSeek R1 – Pas encore parfait

- 💬 Et vous dans tout ça ? Comment exploiter DeepSeek-R1 dès aujourd'hui

- 🌟 L'open-source peut-il gagner la guerre de l'IA ?

Imaginez un étudiant qui, sans professeur, apprend à résoudre des équations complexes en s’auto-évaluant grâce à des récompenses. Maintenant, transposez cela à l’IA : c’est exactement ce qu’a fait DeepSeek, une startup chinoise, avec son modèle DeepSeek-R1. Ce dernier rivalise avec OpenAI o1 (le modèle phare d’OpenAI pour la résolution de problèmes) en mathématiques, code et raisonnement… à un coût 95% inférieur ! Et cerise sur le gâteau : le modèle est open-source. Plongée dans une innovation qui pourrait redéfinir l’accès à l’IA avancée. 😊

🔍 DeepSeek-R1 décrypté : Comment ça marche ?

Pour comprendre cette avancée, il faut plonger dans deux concepts clés : le Reinforcement Learning (RL) et le Supervised Fine-Tuning (SFT).

Le Reinforcement Learning (RL) fonctionne comme un enfant qui apprend à jouer aux échecs. Il essaie des coups, gagne parfois, perd souvent, et ajuste sa stratégie en fonction des récompenses (victoires) ou des punitions (défaites). Le RL fonctionne de la même manière : le modèle DeepSeek-R1-Zero (version initiale) a appris sans données étiquetées, uniquement en testant des solutions, recevant des "récompenses" virtuelles pour ses bonnes réponses, et affinant ses raisonnements.

Après cette phase autodidacte, DeepSeek a ajouté un "tuteur humain" via le Supervised Fine-Tuning (SFT). Le modèle a été affiné avec des données supervisées pour corriger ses erreurs (ex : réponses confuses ou mélange de langues) et améliorer sa clarté.

Pensez à un athlète qui s’entraîne seul (RL), puis affine sa technique avec un coach (SFT).

DeepSeek a utilisé DeepSeek-V3, un modèle open-source existant, comme point de départ. Ensuite, le modèle a été entraîné sur des millions de problèmes de maths, de code et de logique, sans correction humaine. Il a appris à auto-évaluer ses réponses via un système de récompenses. Pour corriger les défauts (ex : manque de lisibilité), les chercheurs ont ajouté des exemples de réponses idéales, comme un professeur qui montre la bonne méthode. Enfin, une combinaison de RL et SFT a permis d'équilibrer créativité et précision. Tout cela l'a rendu capable de résoudre des problèmes complexes en mathématiques, en codage et en raisonnement, rivalisant avec OpenAI o1, un des leaders du domaine.

📊 Performances – Un modèle qui rivalise avec les humains (et les géants de l'IA)

DeepSeek-R1 a été testé sur plusieurs benchmarks, démontrant des performances impressionnantes.

En mathématiques, il a obtenu 79,8% de réussite à l'AIME 2024, un test ultra-complexe réservé aux meilleurs lycéens américains, contre 79,2% pour OpenAI o1. Sur le dataset MATH-500, qui inclut des problèmes de niveau universitaire, il a atteint 97,3% de précision.

En programmation, DeepSeek-R1 a obtenu un score de 2 029 sur Codeforces, surpassant 96,3% des participants humains. Le modèle résout des défis algorithmiques en temps limité, comme optimiser un tri de données ou gérer des structures complexes. Par exemple, il peut générer un code pour trouver le plus court chemin dans un labyrinthe 3D, tout en expliquant sa logique.

En culture générale et logique, DeepSeek-R1 a atteint 90,8% de précision au MMLU (Massive Multitask Language Understanding), contre 91,8% pour OpenAI o1. Ce test couvre des domaines variés comme la philosophie, l'histoire et les sciences. Par exemple, si vous demandez « Expliquez la théorie de la relativité d'Einstein à un enfant de 10 ans », le modèle décompose les concepts en métaphores simples (ex : « Imagine que l'espace est une couverture étirée... »).

💡 Pourquoi DeepSeek R1 change la donne ?

DeepSeek est open source, ce qui signifie que tout le monde peut accéder à son code, l’utiliser, ou même l’améliorer. C’est comme si une entreprise ouvrait les plans d’une voiture électrique révolutionnaire et disait : "Prenez ce que vous voulez, et faites-en encore mieux !". Par consequent l'industrie de l'IA a vu l'emergence de plusieurs modèles dérivés (ex : Qwen-1.5B) surpassent GPT-4o. La communauté peut adapter DeepSeek à des niches : éducation, santé, finance...

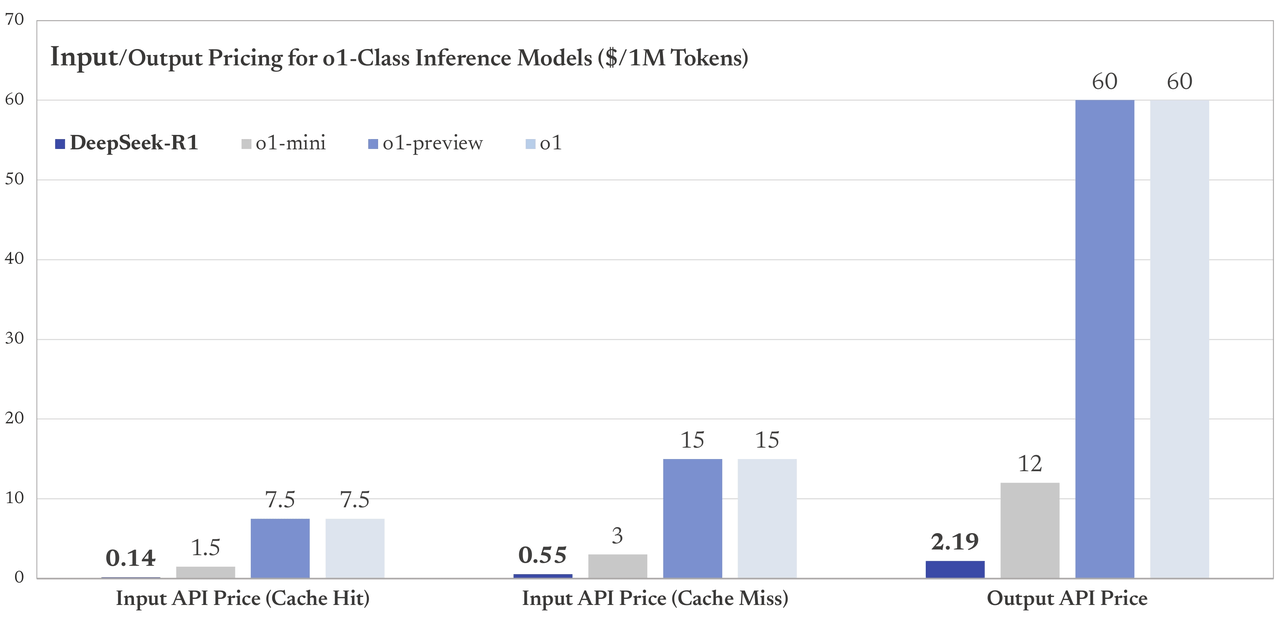

Et ce n’est pas tout : L'un des aspects les plus révolutionnaires de DeepSeek-R1 est son coût divisé par 20 par rapport à OpenAI o1. Par exemple :

- OpenAI o1 facture 15 $ par million de tokens analysés en entrée.

- DeepSeek-R1 ne coûte que 0,55 $ pour le même service.

Imaginez les possibilités pour les petites entreprises, les développeurs indépendants, ou même les étudiants qui souhaitent expérimenter avec une IA puissante sans dépenser une fortune.

🔮 L’Avenir de l’IA Open Source

DeepSeek-R1 n’est pas juste un modèle d’IA, c’est un signal clair que l’open source peut rivaliser avec les titans commerciaux dans la course vers l’intelligence artificielle générale (AGI) – une IA capable d’accomplir des tâches intellectuelles à la manière d’un humain. Cette avancée pose une question cruciale : et si l’AGI (IA générale) n’était plus réservée aux géants technologiques ?

Dans un premier scénario, les startups open-source pourraient dépasser les géants en agilité. Par exemple, Stability AI (créateur de Stable Diffusion) a montré que l'open-source peut dominer un secteur (génération d'images).

Les implications sont gigantesques :

- Accessibilité : Des outils ultra-puissants deviennent accessibles à tous.

- Innovation accélérée : La transparence encourage la collaboration et les progrès rapides.

- Démocratisation de l’IA : Plus besoin d’un budget astronomique pour expérimenter ou développer avec des IA avancées.

Cependant, cette démocratisation soulève des risques éthiques inédits. Si n'importe qui peut entraîner une IA super-puissante, comment éviter les abus (deepfakes, désinformation) ?

Le rôle des gouvernements et de la communauté sera crucial. Faut-il réguler l'accès aux modèles open-source ? Ou au contraire, financer des projets éthiques (ex : IA pour le climat) ?

🚨 Les limites de DeepSeek R1 – Pas encore parfait

Malgré ses performances impressionnantes, R1 présente quelques limites.

Le modèle initial (R1-Zero) mélangeait parfois des langues ou produisait des explications confuses. Bien que la phase SFT ait corrigé ces défauts, des erreurs subsistent dans les réponses longues.

De plus, les benchmarks comme MMLU ou Codeforces sont majoritairement en anglais. Le modèle pourrait moins bien performer sur des problèmes culturellement spécifiques (ex : dialectes locaux, contextes non-occidentaux).

💬 Et vous dans tout ça ? Comment exploiter DeepSeek-R1 dès aujourd'hui

DeepSeek ouvre des possibilités infinies pour les développeurs, chercheurs et entrepreneurs.

En éducation, vous pourriez créer un tuteur IA pour les élèves en difficulté. En DevOps, le modèle peut générer des scripts automatisés pour le déploiement AWS ou la résolution de bugs. En recherche, il permet de simuler des problèmes complexes, comme la modélisation climatique.

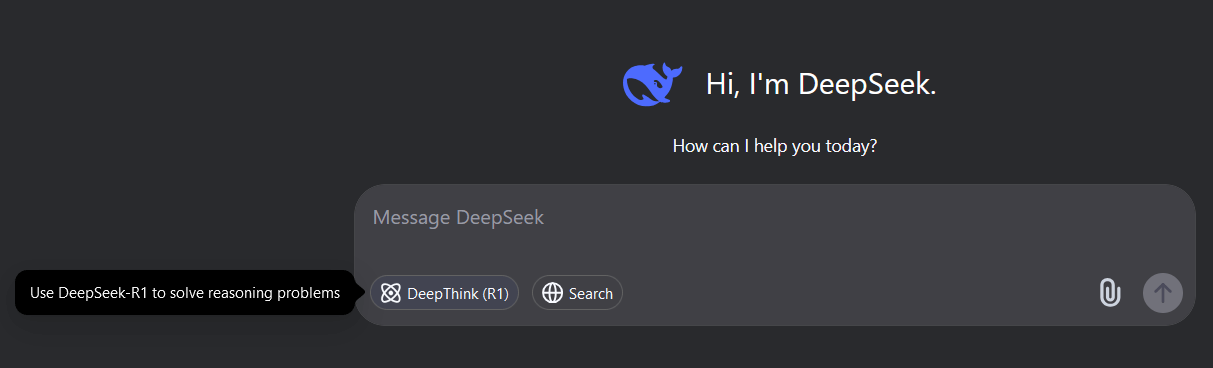

👉 Pour tester DeepSeekR1, le modèle est disponible en chatbot ici : DeepSeek Chat.

👉 Pour intégrer DeepSeekR1 dans votre projet, deux options s'offrent à vous : utiliser l'API DeepSeek (https://platform.deepseek.com) – aussi simple que ChatGPT – ou télécharger le modèle sur Hugging Face (https://huggingface.co/deepseek) pour un contrôle total.

🌟 L'open-source peut-il gagner la guerre de l'IA ?

DeepSeekR1 n'est pas qu'un modèle – c'est un symbole. Il prouve que l'innovation ne viendra peut-être pas uniquement de Silicon Valley, mais aussi de collaborations globales et open-source. Cette avancée rappelle une citation inspirante d'Alan Kay : "La meilleure façon de prédire l'avenir est de le créer."

🙋 Et vous, qu’en pensez-vous ? :

Faut-il limiter l'accès aux IA puissantes pour éviter les abus, même si cela ralentit l'innovation ?

Comment vous préparer à un monde où l'IA open-source concurrence les outils propriétaires ?

Comment notre continent peut-il tirer parti de ces technologies sans dépendre des USA ou de la Chine ?

👉 Passez à l'action : Testez DeepSeek-R1, partagez vos projets en commentaires, et discutons ensemble de cet avenir passionnant !